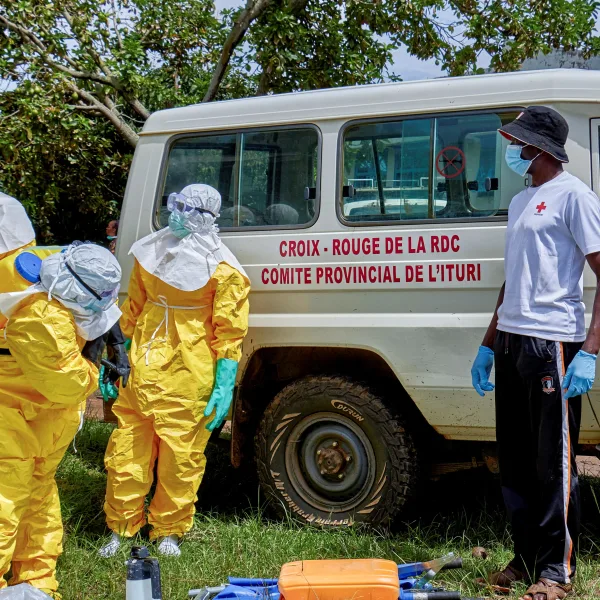

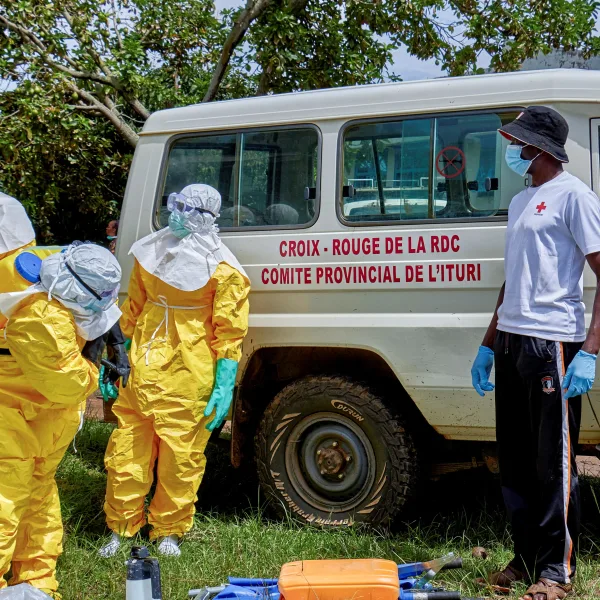

El director general del organismo sostuvo que la enfermedad "se propaga rápidamente" en el país africano.

La OMS eleva el riesgo de ébola en República Democrática del Congo a “muy alto”

Actualidad -

Suscribite a las notificaciones y enterate de todo.

Expertos crearon un software que usa inteligencia artificial con aprendizaje automático que permite agregar, borrar, o cambiar las palabras que están saliendo directamente de la boca de una persona en un video. ¿Avance o retroceso?

El trabajo fue realizado por científicos especializados de Stanford University, The Max Planck Institute for Informatics, Princeton university y Adobe Research. Y demuestra que de manera rápida y sencilla, podremos tener la habilidad de editar lo que alguien está diciendo en videos de manera efectiva y rápida, creando una posible nueva ola de Fake News.

Para conocer cómo funciona, te mostramos el resultado de este sistema con varios ejemplos, incluida la transformación de una frase de Apocalypse now: cambiando el famoso “I love the smell of napalm in the morning”, por “I love the smell of french toast in the morning”.

La instancia en la que se encuentra el proyecto es de plena investigación y no, el software no está disponible para uso público, aunque probablemente no pase mucho tiempo hasta que un servicio similar se lance a generar un sistema parecido, sobre todo después de que los resultados se vuelvan virales.

Para que todo este proceso se lleve a cabo, los científicos combinaron una serie de técnicas. Primero, se escanea el video original en cuestión para obtener fonemas del orador (Sonidos constituyentes como “as”, “os”, “a”) Después, superponen estas silabas con su correspondiente visema (Un visema es cualquiera de varios sonidos del habla que se ven iguales, por ejemplo, cuando se leen los labios) y así, teniendo las expresiones faciales que acompañan cada sonido, el software crea un modelo 3D de la mitad inferior de la boca y mandíbula de la persona que está hablando en el video.

Cuando el usuario escribe el texto que quiere que se reproduzca, el software combina toda esta data recolectada: los fonemas, visemas, y el modelo 3d de la cara editada son los componentes de la fórmula para crear un material completamente nuevo. Por último se pega al video que llamaríamos ‘original’ y voilá, el resultado final está listo.

La pregunta que nos hacemos es: ¿Logra convencer?

Se realizaron varias pruebas al público para comprobar si el producto final podría pasar como verdadero. Un grupo de 138 personas escucharon uno de los discursos editados, y el 60% pensó que era completamente autentico. La cifra no sorprende tanto, pero cabe aclarar que un 20% pensó que el video “real” era falso. Esto puede ser debido a que los invitados fueron notificados que se trataba de un estudio sobre Fake News y edición de video, según nos cuenta The Verge.

Si bien esto suena apetecible para entretener, parodiar, y manejar personajes culturales a nuestro gusto, no tenemos que olvidar que éste software es un arma de doble filo.

Los daños potenciales de esta tecnología son obvios y preocupantes. Los desarrolladores de este tipo de IA son a menudo criticados por no advertir de estos posibles y factibles percances, pero en su defensa, los científicos involucrados en el proyecto, escribieron en un Blog Post:

“Aunque los métodos para la manipulación de imágenes y videos son tan antiguos como los medios en sí mismos, los riesgos de abuso aumentan cuando se aplican a un modo de comunicación que a veces se considera evidencia autorizada de pensamientos e intenciones. Reconocemos que los malos actores pueden usar tales tecnologías para falsificar declaraciones personales y calumniar a personas prominentes”

Los remedios que se proponen no son tan reconfortantes como el público que las críticas quisieran. Básicamente, sugieren que el nuevo material editado con IA se presente como tal, con usos de marcas de agua o dando un contexto a la audiencia de que lo que están presenciando, no es un material original si no uno alterado.

¿Pero qué pasa cuando las marcas de agua son removidas digitalmente, o cuando la falta de contexto es uno de los primordiales ganchos de las noticias virales online? Los desarrolladores prefirieron no centrarse en las malas, y si abordar los pros en vez de los contras. Alegan, que por ejemplo, la industria audiovisual se vería beneficiada al poder modificar diálogos mal dichos en películas y cine, incluso grabar actores en diferentes idiomas.

Los beneficios no parecen ser muchos si los comparamos con el daño potencial colateral a pesar de las aparentes buenas intenciones de los desarrolladores. Aunque hay un buen punto en que las propagandas falsas ya son noticia de todos los días, sin la necesidad de un programa con IA que modifique discursos, el progreso de investigaciones como estas, sigue siendo bastante turbio.

El director general del organismo sostuvo que la enfermedad "se propaga rápidamente" en el país africano.

Actualidad -

Entre los documentos aparecen investigaciones militares, avistamientos en bases nucleares y episodios reportados por astronautas.

Actualidad -

Luis Caputo celebró los resultados de la campaña 2025/2026, impulsada por fuertes niveles de producción en maíz, soja y trigo.

Actualidad -

El canciller Pablo Quirno y la ministra de Capital Humano Sandra Pettovello mantuvieron un encuentro con autoridades del episcopado.

Actualidad -

El histórico ciclo de CBS llegó a su fin después de 11 temporadas y tuvo un cierre cargado de música, humor y emoción. El ex Beatle apareció por sorpresa y acompañó a Colbert en el último programa.

Espectáculos -

El presidente difundió un video para anunciar el lanzamiento del primer “Gemelo Digital Social”, una plataforma desarrollada por el Ministerio de Capital Humano que busca utilizar inteligencia artificial para proyectar impactos y asistir en el diseño de políticas públicas.

Actualidad -